Wir sind in eine neue Phase der KI-Einführung eingetreten: 88 % der KI-Projekte in Unternehmen geraten ins Stocken, bevor sie die Produktionsreife erreichen, nicht aufgrund schlechter Ideen oder schwacher Modelle, sondern weil die Infrastruktur nicht mithalten kann. Cloud-APIs werden schnell teuer. Governance wird erst im Nachhinein berücksichtigt. Latenz summiert sich. Und für regulierte Branchen ist die Übertragung sensibler Daten an einen öffentlichen Endpunkt einfach keine Option.

Um die Lücke zwischen einem KI-Pilotprojekt und einer Serienproduktion zu schließen, muss Intelligence direkt an die Quelle gebracht werden. Der Cloudera AI Inference Service bietet Unternehmensteams eine sichere, leistungsstarke und kostengünstige Serviceebene für Produktionsmodelle, die direkt dort ausgeführt wird, wo sich die Daten befinden.

Anstatt Ihre Daten als Kontext für Modelle in die Cloud zu senden, bringt Cloudera die Modelle zu Ihnen – und macht so Informationen genau dort verfügbar, wo sie benötigt werden, sichert sie durch ihr Design und skaliert sie zuverlässig hinter Ihrer eigenen Firewall.

3 Gründe, warum die Verwendung von KI für Ihre Daten wichtig ist: Datenschutz, Kosten und Auswahlmöglichkeiten im großen Maßstab

Daten privat und geschützt halten

Bei den meisten KI-Diensten müssen Sie Daten in die Cloud senden, was Risiken in Bezug auf Compliance, Kosten und Latenz mit sich bringt. Cloudera verfolgt den Ansatz, Modelle dorthin zu bringen, wo sich Ihre Daten bereits befinden. Ob in einer sicheren Virtual Private Cloud (VPC) oder in einer lokalen Air-Gap-Umgebung (vollständig offline und isoliert) – diese Modell-zu-Daten-Strategie gewährleistet, dass Ihre Informationen privat und kontrolliert bleiben, während gleichzeitig leistungsstarke Inferenzen ermöglicht werden, um KI in der Produktion anzutreiben.

Langfristig vorhersehbare Wirtschaftlichkeit

Das Ausführen von KI in der Cloud rund um die Uhr führt zu exponentiell steigenden, unvorhersehbaren Kosten. Diese Gebühren pro Anfrage führen zu einem Budget, das je nach Nutzung schwankt, sodass langfristige Prognosen schwierig sind. Durch die Verlagerung der Inferenz auf die Infrastruktur, die das Unternehmen bereits besitzt und kontrolliert, können Teams diese externen Nutzungsgebühren umgehen. Sobald die KI in die stabile Produktion übergeht, werden die Kosten besser vorhersehbar, sodass mit der Skalierung der Workloads ein höherer ROI erzielt werden kann.

Kontrolle und Wahlmöglichkeiten

Die meisten Cloud-KI-Anbieter lenken ihre Kunden in ihr proprietäres Ökosystem, was einen Wechsel, eine Erweiterung oder die vollständige Kontrolle Ihrer Modelle erschwert. Mit dem Cloudera AI Inference Service können Sie eine Vielzahl von KI-Funktionen einsetzen, von Open-Source-GenAI-LLMs wie Nemotron von NVIDIA bis hin zu traditionellen Prognosemodelle, ohne die Kontrolle oder Eigentumsrechte an Ihrem geistigen Eigentum aufzugeben. Beschleunigt durch den KI-Stack von NVIDIA –NVIDIA Blackwell GPUs, NVIDIA Dynamo-Triton und NVIDIA NIM Microservices für leistungsstarkes, skalierbares Model Serving – ermöglicht Ihnen der Cloudera AI Inference Service innovative Freiheit und gewährleistet gleichzeitig, dass Ihre KI-Infrastruktur flexibel, portabel und zukunftssicher bleibt.

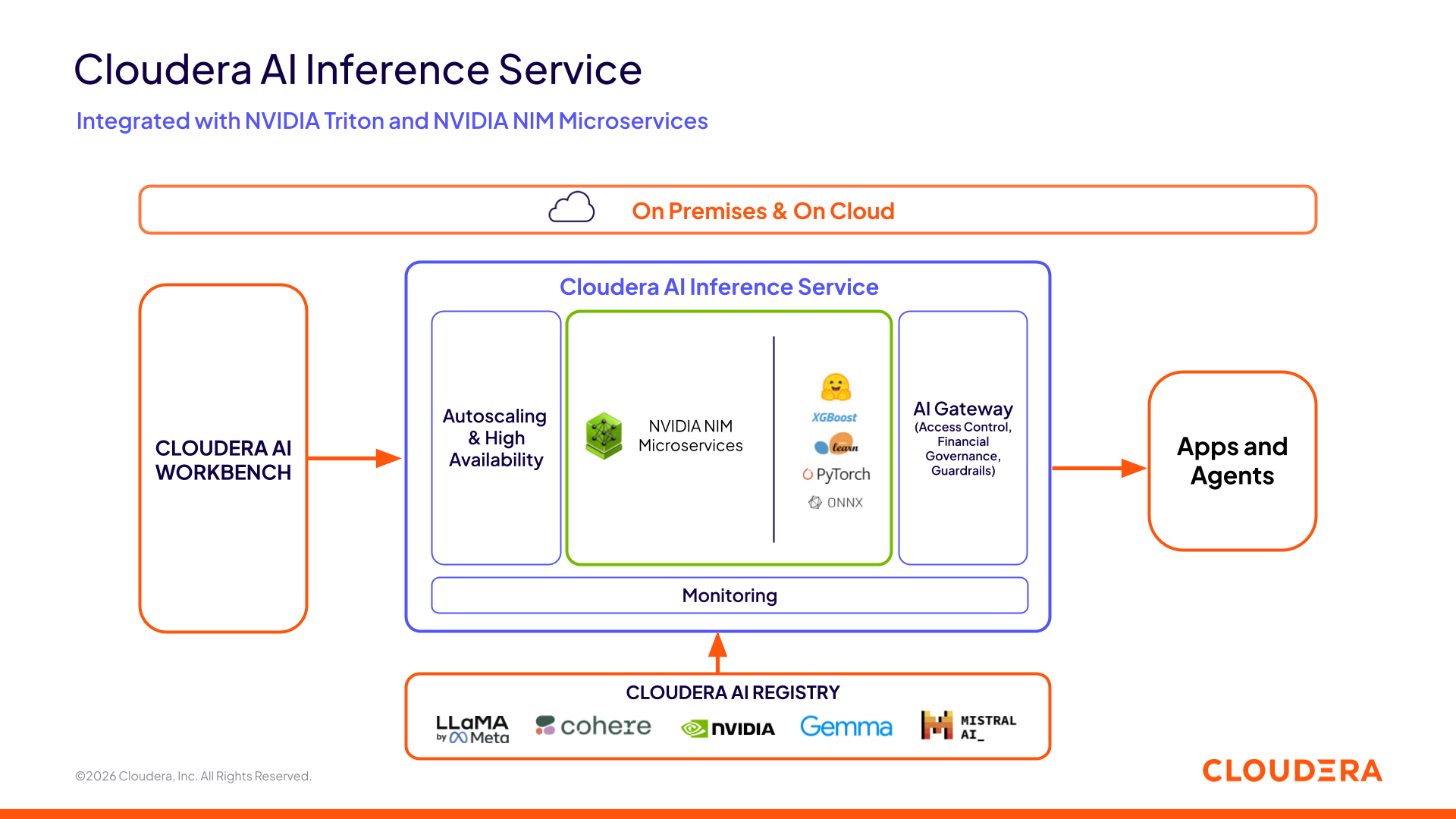

Abbildung 1: Cloudera AI Inference Service-Architektur

Abbildung 1: Cloudera AI Inference Service-Architektur

Erfolgsgeschichten: Frühe Einführung des Cloudera AI Inference Service vor Ort

Der Cloudera AI Inference Service erschließt neue Anwendungsfälle für KI an Orten, an denen die Cloud nicht eingesetzt werden kann: Offline-Umgebungen, staatliche Infrastruktur und latenzkritische Prozesse. Nachfolgend finden Sie drei reale Szenarien, die jetzt durch den Cloudera AI Inference Service ermöglicht werden und bereits bei ersten Anwendern im Einsatz sind.

Nationale Sicherheit: Air-Gap-Intelligence, die niemals schläft oder Daten offenlegt

Bei der nationalen Verteidigung sind Geschwindigkeit und Sicherheit unverzichtbar. Bis vor kurzem verbrachten Geheimdienstmitarbeiter jedoch Tausende von Stunden mit dem manuellen Sichten sensibler Offline-Dokumente – verlangsamt durch den Prozess, überwältigt von der Menge und ohne die Möglichkeit, öffentliche KI-Tools zu nutzen, ohne eine Entdeckung zu riskieren.

Mit dem Cloudera AI Inference Service, der in Air-Gap-Umgebungen ausgeführt wird, können Verteidigungsbehörden nun leistungsstarke LLM-Assistenten einsetzen, die riesige Dokumentensammlungen in Sekundenschnelle scannen und zusammenfassen. Diese Modelle funktionieren vollständig offline: kein Internet, keine Cloud-Abhängigkeiten, keine Datenleck, sodass Analysten schnellere Entscheidungen treffen können, ohne Kompromisse bei der Sicherheit einzugehen zu müssen.

Globales Finanzenwesen: Sofortige Transaktionen, keine Offenlegung von Daten

Grenzüberschreitende Finanzdienstleistungen werden in Dutzenden von Sprachen bereitgestellt. Bisher mussten für die Übersetzung von Dokumenten wie Verträgen, Betrugs-Reports oder Compliance-Updates externe Tools verwendet werden, was ernsthafte Bedenken in Bezug auf die Offenlegung von Daten und die Überprüfbarkeit aufkommen ließ.

Einer der weltweit führenden Kreditkartenanbieter untersucht derzeit den Cloudera AI Inference Service und testet den Einsatz von mehrsprachigen On-Premises-Modellen, um die sensible Kommunikation in mehr als 200 Märkten in Echtzeit und vollständig unter interner Kontrolle zu übersetzen. Durch die Ausführung von Inferenzprozessen auf ihrer eigenen Infrastruktur ermöglichen sie schnellere interne Abläufe und Reaktionszeiten gegenüber Kunden und vermeiden gleichzeitig die Compliance-Risiken der APIs von Drittanbietern.

Öffentlicher Sektor: KI-Agenten für jeden Mitarbeiter

Regierungsbehörden stehen unter Druck, mehr Menschen schneller zu bedienen – dennoch verlassen sich Mitarbeiter oft auf veraltete Portale und umfangreiche Richtlinienhandbücher. Öffentliche GenAI-Tools sind aufgrund von Datenschutzbestimmungen und unvorhersehbaren Kosten keine Option.

Frühzeitige Implementierungen des Cloudera AI Inference Service unterstützen On-Premises-KI-Chatbots, die auf internen Agenturdokumenten trainiert wurden. Diese Agenten helfen Mitarbeitern und Bürgern, sich schnell und sicher in komplexen Themen zurechtzufinden. Sie liefern sofortige Antworten und behalten dabei die volle Kontrolle über die Daten, Prompts und Ausgaben.

Ausblick: Die Zukunft der KI liegt überall dort, wo Daten vorhanden sind

Indem das Modell dorthin gebracht wird, wo Ihre Daten gespeichert sind, unterstützt der Cloudera AI Inference Service Unternehmen bei der Skalierung ihrer Intelligence nach ihren eigenen Vorstellungen – mit vorhersehbaren Kosten und der Flexibilität, aus einer Vielzahl von Produktionsmodellen auszuwählen. Ob Sie nun Sicherheitsvorschriften für Air-Gap-Systeme navigieren oder globale Großprojekte optimieren, der Weg zur produktionsreifen KI steht nun offen.

Cloudera AI ist die vertrauenswürdige Grundlage für den Aufbau, die Bereitstellung und die Verwaltung aller Arten von KI – von generativer und agentischer KI bis hin zu traditionellem maschinellem Lernen – in Ihrem Datenbestand.

Bereit für die Skalierung? Lassen Sie nicht zu, dass die Infrastruktur die KI-Strategie einschränkt. Besuchen Sie die Webseite von Cloudera AI Inference Service, um Anwendungsbeispiele zu erhalten. Erfahren Sie mehr darüber in diesem Webinar. Oder buchen Sie eine Demo, um zu erleben, wie Sie „KI überall“ in die Realität umsetzen können.